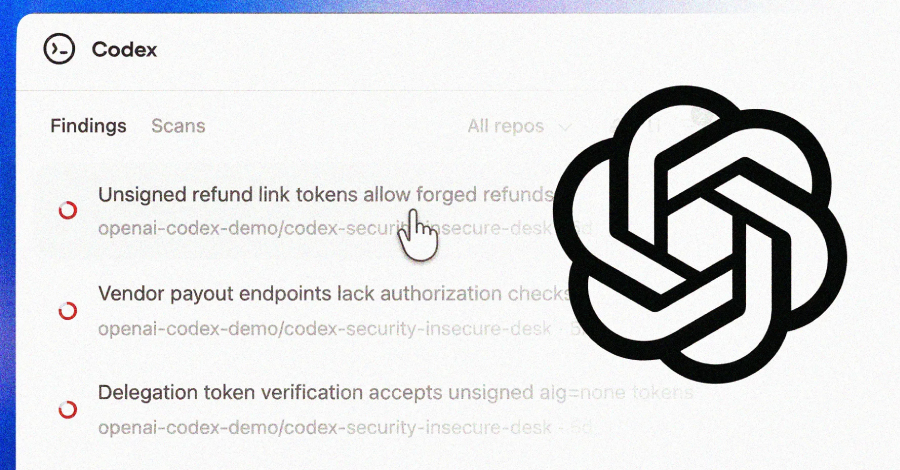

OpenAI comenzó a lanzarse el viernes Seguridad del Codex , un agente de seguridad basado en inteligencia artificial (IA) diseñado para encontrar, validar y proponer soluciones para las vulnerabilidades.

La función está disponible en una versión preliminar de la investigación para los clientes de ChatGPT Pro, Enterprise, Business y Edu a través de la web del Codex, con uso gratuito durante el próximo mes.

«Crea un contexto profundo sobre su proyecto para identificar vulnerabilidades complejas que otras herramientas de agencia pasan por alto, y arroja hallazgos de mayor confianza con soluciones que mejoran de manera significativa la seguridad de su sistema y, al mismo tiempo, evitan el ruido de errores insignificantes», dijo la empresa dijo .

Codex Security representa una evolución de Oso hormiguero , que OpenAI presentó en versión beta privada en octubre de 2025 como una forma para que los desarrolladores y los equipos de seguridad detecten y corrijan las vulnerabilidades de seguridad a gran escala.

adsenseDurante los últimos 30 días, Codex Security ha escaneado más de 1,2 millones de confirmaciones en repositorios externos a lo largo de la versión beta, identificando 792 hallazgos críticos y 10.561 hallazgos de alta gravedad. Estas incluyen vulnerabilidades en varios proyectos de código abierto como OpenSSH, GnuTLS, GOGS, Thorium, libssh, PHP y Chromium, entre otros. Algunas de ellas se enumeran a continuación:

- GnuPG: CVE-2026-24881, CVE-2026-24882

- GNUTLS: CVE-2025-32988, CVE-2025-32989

- PERROS - CVE-2025-64175, CVE-2026-25242

- Torio - CVE-2025-35430, CVE-2025-35431, CVE-2025-35432, CVE-2025-35433, CVE-2025-35434, CVE-2025-35435, CVE-2025-35436

Según la empresa de inteligencia artificial, la última versión del agente de seguridad de aplicaciones aprovecha las capacidades de razonamiento de sus modelos de vanguardia y las combina con la validación automatizada para minimizar el riesgo de falsos positivos y ofrecer soluciones viables.

Los escaneos de OpenAI en los mismos repositorios a lo largo del tiempo han demostrado una precisión cada vez mayor y una disminución de las tasas de falsos positivos, con una caída de más del 50% en todos los repositorios.

En una declaración compartida con The Hacker News, OpenAI dijo que Codex Security está diseñado para mejorar la relación señal/ruido al basar el descubrimiento de vulnerabilidades en el contexto del sistema y validar los hallazgos antes de mostrarlos a los usuarios.

En concreto, el agente funciona en tres pasos: analiza un repositorio para hacerse una idea de la estructura del sistema relevante para la seguridad del proyecto y genera un modelo de amenazas editable que captura lo que hace y dónde está más expuesto.

Una vez creado el contexto del sistema, Codex Security lo utiliza como base para identificar las vulnerabilidades y clasificar los hallazgos en función de su impacto en el mundo real. Los problemas detectados se someten a pruebas de presión en un entorno aislado para validarlos.

enlaces«Cuando Codex Security se configura con un entorno adaptado a su proyecto, puede validar los posibles problemas directamente en el contexto del sistema en ejecución», afirma OpenAI. «Esa validación más profunda puede reducir aún más los falsos positivos y permitir la creación de pruebas de concepto que funcionen, lo que brinda a los equipos de seguridad pruebas más sólidas y un camino más claro hacia la solución».

La etapa final implica que el agente proponga las correcciones que mejor se alineen con el comportamiento del sistema para reducir las regresiones y facilitar su revisión e implementación.

Las noticias sobre Codex Security llegan semanas después del lanzamiento de Anthropic Seguridad de Claude Code para ayudar a los usuarios a escanear una base de código de software en busca de vulnerabilidades y sugerir parches.

Fuentes de Información: THEHACKERNEWS