A medida que los copilotos y asistentes de IA se integran en el trabajo diario, los equipos de seguridad siguen centrándose en proteger los propios modelos. Sin embargo, los incidentes recientes sugieren que el mayor riesgo reside en otra parte: en los flujos de trabajo que rodean a esos modelos.

Recientemente aparecieron dos extensiones de Chrome que se hacían pasar por ayudantes de IA atrapado robando datos de chat de ChatGPT y DeepSeek de más de 900 000 usuarios. Por separado, los investigadores demostrada cómo las inyecciones rápidas ocultas en los repositorios de código podían engañar al asistente de codificación de IA de IBM para que ejecutara malware en la máquina de un desarrollador.

Ninguno de los dos ataques rompió los algoritmos de la IA en sí mismos.

Aprovecharon el contexto en el que opera la IA. Ese es el patrón al que vale la pena prestar atención. Cuando los sistemas de inteligencia artificial están integrados en procesos empresariales reales, resumiendo documentos, redactando correos electrónicos y extrayendo datos de herramientas internas, proteger el modelo por sí solo no es suficiente. El flujo de trabajo en sí mismo se convierte en el objetivo.

Los modelos de IA se están convirtiendo en motores de flujo de trabajo

Para entender por qué esto es importante, considera cómo se usa realmente la IA en la actualidad:

Las empresas ahora confían en él para conectar aplicaciones y automatizar tareas que antes se hacían a mano. Un asistente de redacción basado en inteligencia artificial puede extraer un documento confidencial de SharePoint y resumirlo en un borrador de correo electrónico. Un chatbot de ventas puede hacer una referencia cruzada de los registros internos de CRM para responder a la pregunta de un cliente. Cada uno de estos escenarios difumina los límites entre las aplicaciones, creando nuevas vías de integración sobre la marcha.

Lo que hace que esto sea riesgoso es la forma en que operan los agentes de IA. Se basan en la toma de decisiones probabilística más que en reglas codificadas, y generan resultados basados en patrones y contextos. Un aporte redactado con cuidado puede empujar a una IA a hacer algo que sus diseñadores nunca tuvieron la intención de hacer, y la IA cumplirá porque no tiene un concepto nativo de límites de confianza.

Esto significa que la superficie de ataque incluye todos los puntos de entrada, salida e integración que toca el modelo.

Hackear el código del modelo se vuelve innecesario cuando un adversario puede simplemente manipular el contexto que ve el modelo o los canales que utiliza. Los incidentes descritos anteriormente ilustran este aspecto: las inyecciones rápidas ocultas en los repositorios secuestran el comportamiento de la IA durante las tareas rutinarias, mientras que las extensiones malintencionadas extraen datos de las conversaciones de la IA sin tocar el modelo.

Por qué los controles de seguridad tradicionales son insuficientes

Estas amenazas al flujo de trabajo exponen un punto ciego en la seguridad tradicional. La mayoría de las defensas antiguas se crearon para el software determinista, los roles de usuario estables y los perímetros despejados. Los flujos de trabajo impulsados por la inteligencia artificial rompen los tres supuestos.

- La mayoría de las aplicaciones generales distinguen entre código confiable y entradas no confiables. Los modelos de IA no lo hacen. Para ellos, todo es solo texto, por lo que una instrucción maliciosa escondida en un PDF no tiene un aspecto diferente al de un comando legítimo. La validación de entradas tradicional no ayuda porque la carga no es un código malintencionado. Es solo lenguaje natural.

- La supervisión tradicional detecta anomalías obvias, como descargas masivas o inicios de sesión sospechosos. Sin embargo, una IA que lee mil registros como parte de una consulta rutinaria tiene el mismo aspecto que el tráfico normal de servicio a servicio. Si esos datos se resumen y se envían a un atacante, técnicamente no se ha infringido ninguna regla.

- La mayoría de las políticas de seguridad generales especifican lo que está permitido o bloqueado: no permita que este usuario acceda a ese archivo o bloquee el tráfico a este servidor. Sin embargo, el comportamiento de la IA depende del contexto. ¿Cómo se escribe una regla que diga «nunca reveles los datos de los clientes en los resultados»?

- Los programas de seguridad se basan en revisiones periódicas y configuraciones fijas, como auditorías trimestrales o reglas de firewall. Los flujos de trabajo de la IA no permanecen estáticos. Una integración puede obtener nuevas capacidades después de una actualización o conectarse a una nueva fuente de datos. Cuando se lleve a cabo una revisión trimestral, es posible que ya se haya filtrado un token.

Proteger los flujos de trabajo impulsados por la IA

Por lo tanto, un mejor enfoque para todo esto sería tratar todo el flujo de trabajo como lo que estás protegiendo, no solo como el modelo.

- Empieza por entender dónde se usa realmente la IA, desde herramientas oficiales como Microsoft 365 Copilot hasta extensiones de navegador que los empleados puedan haber instalado por su cuenta. Sepa a qué datos puede acceder cada sistema y qué acciones puede realizar. Muchas organizaciones se sorprenden al encontrar docenas de IA en la sombra servicios que funcionan en toda la empresa.

- Si un asistente de IA está diseñado solo para resumir internamente, restrinja el envío de correos electrónicos externos. Escanee los datos confidenciales de los datos salientes antes de que salgan de su entorno. Estas barreras deben estar fuera del propio modelo, en un software intermedio que compruebe las acciones antes de que se publiquen.

- Trate a los agentes de IA como a cualquier otro usuario o servicio. Si una IA solo necesita acceso de lectura a un sistema, no le dé acceso total a todo. Aplica los tokens de OAuth a los permisos mínimos requeridos y monitoriza para detectar anomalías, por ejemplo, si una IA accede de repente a datos que nunca antes había utilizado.

- Por último, también es útil para informar a los usuarios sobre los riesgos de las extensiones de navegador no examinadas o de copiar instrucciones de fuentes desconocidas. Revisa los complementos de terceros antes de implementarlos y considera que cualquier herramienta que toque las entradas o salidas de la IA forma parte del perímetro de seguridad.

Cómo pueden ayudar plataformas como Reco

En la práctica, hacer todo esto manualmente no se escala. Por eso está surgiendo una nueva categoría de herramientas: las plataformas de seguridad SaaS dinámicas. Estas plataformas actúan como una barrera en tiempo real sobre los flujos de trabajo impulsados por la inteligencia artificial, ya que aprenden cómo es el comportamiento normal y detectan las anomalías cuando se producen.

Reco es un ejemplo destacado.

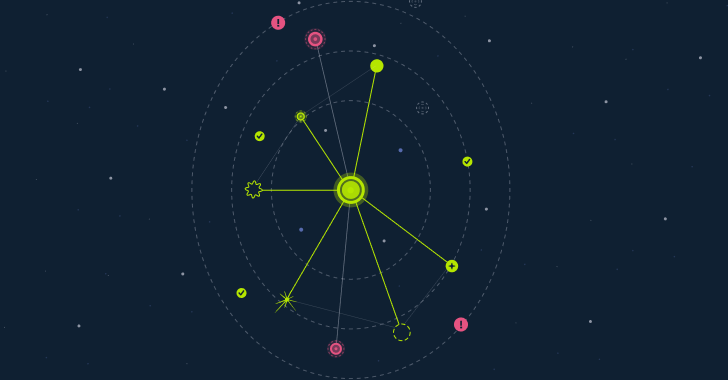

|

| Figura 1: Descubrimiento de aplicaciones de IA generativas de Reco |

Como se muestra arriba, la plataforma brinda a los equipos de seguridad visibilidad sobre el uso de la IA en toda la organización, revelando qué aplicaciones de IA generativa están en uso y cómo están conectadas. A partir de ahí, puede reforzar las barreras a nivel del flujo de trabajo, detectar los comportamientos de riesgo en tiempo real y mantener el control sin ralentizar el negocio.

Solicite una demostración: comience con Reco .

Post generado automáticamente, fuente oficial de la información: THEHACKERNEWS