Anthropic se ha convertido en la última empresa de inteligencia artificial (IA) en anunciar un nuevo conjunto de funciones que permiten a los usuarios de su plataforma Claude comprender mejor su información de salud.

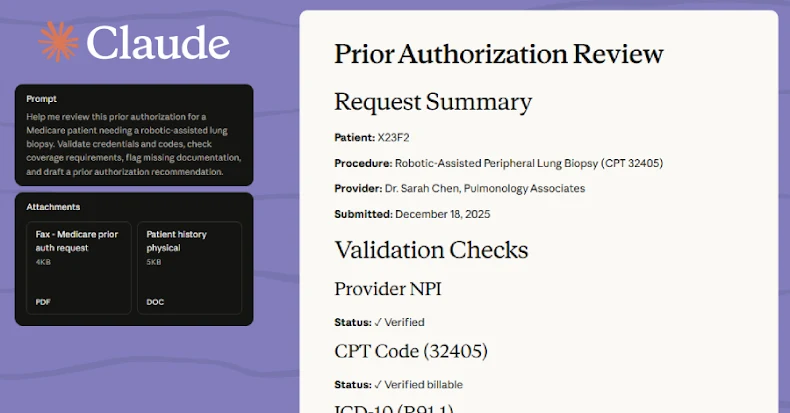

En el marco de una iniciativa denominada Claude para el cuidado de la salud , la compañía dijo que los suscriptores estadounidenses de los planes Claude Pro y Max pueden optar por darle a Claude un acceso seguro a sus resultados de laboratorio e historiales médicos mediante conectarse a HealtheX y Function , y las integraciones de Apple Health y Android Health Connect se lanzarán a finales de esta semana a través de sus aplicaciones para iOS y Android.

«Cuando está conectado, Claude puede resumir el historial médico de los usuarios, explicar los resultados de las pruebas en un lenguaje sencillo, detectar patrones en las métricas de estado físico y salud y preparar preguntas para las citas», Anthropic dijo . «El objetivo es hacer que las conversaciones de los pacientes con los médicos sean más productivas y ayudar a los usuarios a mantenerse bien informados sobre su salud».

El desarrollo se produce pocos días después de la presentación de OpenAI Salud de ChatGPT como una experiencia dedicada para que los usuarios conecten de forma segura los registros médicos y las aplicaciones de bienestar y obtengan respuestas personalizadas, información de laboratorio, consejos de nutrición e ideas para comidas.

La compañía también señaló que las integraciones son privadas por diseño, y los usuarios pueden elegir explícitamente el tipo de información que quieren compartir con Claude y desconectar o editar los permisos de Claude en cualquier momento. Al igual que con OpenAI, los datos de salud no se utilizan para entrenar sus modelos.

La expansión se produce en medio de un creciente escrutinio sobre si los sistemas de IA pueden evitar ofrecer una orientación dañina o peligrosa. Recientemente, Google intervino para retirar algunos de sus sumarios de IA después de que se descubriera que proporcionaban información de salud inexacta. Tanto OpenAI como Anthropic han hecho hincapié en que sus ofertas de IA pueden cometer errores y no sustituyen el asesoramiento sanitario profesional.

En la Política de uso aceptable, Anthropic notas que un profesional calificado en el campo debe revisar los resultados generados «antes de su difusión o finalización» en los casos de uso de alto riesgo relacionados con las decisiones de atención médica, el diagnóstico médico, la atención al paciente, la terapia, la salud mental u otra orientación médica.

«Claude está diseñado para incluir descargos de responsabilidad contextuales, reconocer su incertidumbre y dirigir a los usuarios a los profesionales de la salud para que les brinden orientación personalizada», dijo Anthropic.

Post generado automaticamente, fuente oficial de la información: THEHACKERNEWS