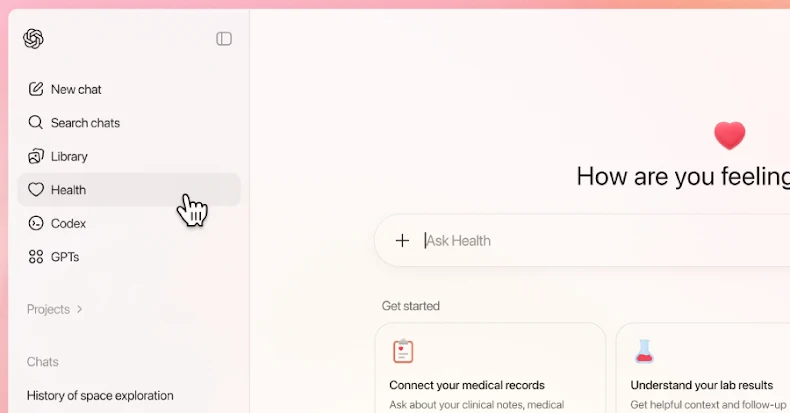

La empresa de inteligencia artificial (IA) OpenAI anunció el miércoles el lanzamiento de ChatGPT Health, un espacio dedicado que permite a los usuarios conversar con el chatbot sobre su salud.

Para ello, la experiencia en entorno aislado ofrece a los usuarios la posibilidad opcional de conectar de forma segura las historias clínicas y las aplicaciones de bienestar, como Apple Health, Function, MyFitnessPal, Weight Watchers, AllTrails, Instacart y Peloton, para obtener respuestas personalizadas, información sobre las pruebas de laboratorio, consejos de nutrición, ideas de comidas personalizadas y sugerencias de clases de entrenamiento.

La nueva función se está implementando para los usuarios con los planes ChatGPT Free, Go, Plus y Pro fuera del Espacio Económico Europeo, Suiza y el Reino Unido.

«ChatGPT Health se basa en los sólidos controles de privacidad, seguridad y datos de ChatGPT con protecciones adicionales en capas diseñadas específicamente para la salud, que incluyen el cifrado y el aislamiento diseñados específicamente para mantener las conversaciones de salud protegidas y compartimentadas», OpenAI dijo en un comunicado.

Al afirmar que más de 230 millones de personas en todo el mundo hacen preguntas relacionadas con la salud y el bienestar en la plataforma cada semana, OpenAI enfatizó que la herramienta está diseñada para apoyar la atención médica, no para reemplazarla o usarse como sustituto del diagnóstico o el tratamiento.

La empresa también destacó las diversas funciones de privacidad y seguridad integradas en la experiencia de salud -

- Health opera de forma aislada con una privacidad mejorada y su propia memoria para proteger los datos confidenciales mediante el cifrado y el aislamiento «diseñados específicamente»

- Las conversaciones en salud no se utilizan para entrenar los modelos básicos de OpenAI

- A los usuarios que intenten mantener una conversación relacionada con la salud en ChatGPT se les pide que cambien a Salud para obtener protecciones adicionales

- La información y los recuerdos de salud no se utilizan para contextualizar los chats no relacionados con la salud

- Las conversaciones fuera de Health no pueden acceder a los archivos, conversaciones o recuerdos creados dentro de Health

- Las aplicaciones solo pueden conectarse con los datos de salud de los usuarios con su permiso explícito, incluso si ya están conectados a ChatGPT para mantener conversaciones fuera de Health

- Todas las aplicaciones disponibles en Health deben cumplir con los requisitos de privacidad y seguridad de OpenAI, como recopilar solo los datos mínimos necesarios y someterse a una revisión de seguridad adicional para poder incluirlas en Health

Además, OpenAI señaló que ha evaluado el modelo que potencia la salud frente a los estándares clínicos utilizando Banco de salud , un punto de referencia que la compañía reveló en mayo de 2025 como una forma de medir mejor las capacidades de los sistemas de inteligencia artificial para la salud, centrándose en la seguridad, la claridad y la intensificación de la atención.

«Este enfoque basado en la evaluación ayuda a garantizar que el modelo funcione bien en las tareas con las que las personas realmente necesitan ayuda, como explicar los resultados de laboratorio en un lenguaje accesible, preparar las preguntas para una cita, interpretar los datos de los dispositivos portátiles y las aplicaciones de bienestar y resumir las instrucciones de cuidado», añadió.

El anuncio de OpenAI sigue a una investigación de The Guardian que encontrado Google AI Overviews proporciona información de salud falsa y engañosa. OpenAI y Character.AI también lo son enfrentando varias demandas reclamando sus herramientas llevó a las personas al suicidio y a delirios dañinos después de confiar en el chatbot. ¿Un informe publicado de SFGate a principios de esta semana detalló cómo un joven de 19 años murió por una sobredosis de drogas después de confiar en ChatGPT para recibir asesoramiento médico.

Post generado automaticamente, fuente oficial de la información: THEHACKERNEWS