Los investigadores de ciberseguridad han revelado detalles de una vulnerabilidad ahora parcheada en la popular figma-desarrollador-mcp Protocolo de contexto modelo ( MCP ) servidor que podría permitir a los atacantes ejecutar código.

La vulnerabilidad, rastreada como CVE-2025-53967 (puntuación CVSS: 7,5), es un error de inyección de comandos que se debe al uso no saneado de la entrada del usuario, lo que abre la puerta a una situación en la que un atacante puede enviar comandos arbitrarios del sistema.

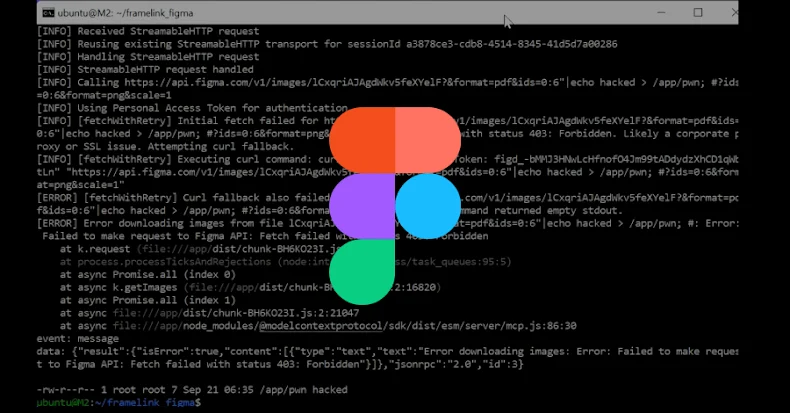

«El servidor construye y ejecuta comandos de shell utilizando entradas de usuario no validadas directamente dentro de las cadenas de la línea de comandos. Esto introduce la posibilidad de inyectar metacaracteres en el shell (|, >, &&, etc.)», según un Asesoramiento de GitHub por el defecto. «Una explotación exitosa puede llevar a la ejecución remota de código con los privilegios del proceso del servidor».

Dado que el servidor Figma MCP de Framelink expone varias herramientas para realizar operaciones en Figma utilizando agentes de codificación impulsados por inteligencia artificial (IA) como Cursor, un atacante podría engañar al cliente MCP para que ejecute acciones no deseadas mediante una inyección de mensajes indirecta.

La empresa de ciberseguridad Imperva, que descubrió y denunció el problema en julio de 2025, descrito El CVE-2025-53967 es un «descuido de diseño» en el mecanismo alternativo que podría permitir a los actores malintencionados ejecutar código completamente de forma remota, lo que pondría a los desarrolladores en riesgo de exponer los datos.

La falla de inyección de comandos «se produce durante la construcción de una instrucción de línea de comandos utilizada para enviar tráfico al punto final de la API de Figma», afirma el investigador de seguridad Yohann Sillam.

La secuencia de explotación se lleva a cabo a través de etapas -

- El cliente MCP envía una solicitud de inicialización al punto final MCP para recibir un mcp-session-id que se utilizará en la comunicación posterior con el servidor MCP

- El cliente envía una solicitud JSONRPC al servidor MCP con el método tools/call para llamar a herramientas como get_figma_data o download_figma_images

El problema, en esencia, reside en «src/utils/fetch-with-retry.ts», que primero intenta obtener contenido mediante la API de búsqueda estándar y, si eso falla, procede a ejecutar el comando curl a través de child_process.exec, lo que introduce el error de inyección de comandos.

«Como el comando curl se crea interpolando directamente los valores de URL y encabezado en una cadena de comandos de shell, un actor malintencionado podría crear una URL o un valor de encabezado especialmente diseñado que inyecte comandos de shell arbitrarios», afirma Imperva. «Esto podría provocar la ejecución remota de código (RCE) en la máquina host».

En un ataque de prueba de concepto, un intruso remoto en la misma red (por ejemplo, una red Wi-Fi pública o un dispositivo corporativo comprometido) puede provocar la falla enviando una serie de solicitudes al MCP vulnerable. Como alternativa, el atacante podría engañar a la víctima para que visitara un sitio especialmente diseñado como parte de un Ataque de reenlace de DNS .

La vulnerabilidad se ha abordado en versión 0.6.3 de figma-developer-mcp, que se publicó el 29 de septiembre de 2025. Como medida paliativa, se recomienda evitar el uso de child_process.exec con entradas que no sean de confianza y cambiar a child_process.execFile para eliminar el riesgo de interpretación del shell.

«A medida que las herramientas de desarrollo impulsadas por la IA siguen evolucionando y ganando adopción, es esencial que las consideraciones de seguridad sigan el ritmo de la innovación», afirma la empresa propiedad de Thales. «Esta vulnerabilidad es un claro recordatorio de que incluso las herramientas diseñadas para ejecutarse localmente pueden convertirse en poderosos puntos de entrada para los atacantes».

El desarrollo se produce cuando FireTail reveló que Google ha optado por no arreglar un nuevo Contrabando ASCII ataque en su chatbot de IA Gemini que podría convertirse en arma para insumos artesanales eso puede resbalarse por filtros de seguridad e inducir respuestas indeseables . Otros grandes modelos lingüísticos (LLM) susceptibles a este ataque son DeepSeek y Grok de xAI.

«Y esta falla es particularmente peligrosa cuando las LLM, como Gemini, están profundamente integradas en plataformas empresariales como Google Workspace», dijo la empresa dijo . «Esta técnica permite la suplantación automática de identidades y el envenenamiento sistemático de datos, lo que convierte una falla en la interfaz de usuario en una posible pesadilla de seguridad».

Post generado automaticamente, fuente oficial de la información: THEHACKERNEWS