Las duras verdades de la adopción de la IA

MITS El estado de la IA en los negocios El informe reveló que, si bien el 40% de las organizaciones han adquirido suscripciones empresariales de LLM, más del 90% de los empleados utilizan activamente herramientas de inteligencia artificial en su trabajo diario. Del mismo modo, una investigación de Harmonic Security descubrió que El 45,4% de las interacciones sensibles de la IA provienen de cuentas de correo electrónico personales, donde los empleados eluden por completo los controles corporativos.

Esto, comprensiblemente, ha generado muchas preocupaciones en torno a una creciente «economía de IA en la sombra». Pero, ¿qué significa eso y cómo pueden los equipos de seguridad y gobierno de la IA superar estos desafíos?

El uso de la IA lo impulsan los empleados, no los comités

Las empresas ven incorrectamente el uso de la IA como algo que viene de arriba hacia abajo, definido por sus propios líderes empresariales visionarios. Ahora sabemos que eso está mal. En la mayoría de los casos, los empleados impulsan la adopción de abajo hacia arriba, a menudo sin supervisión, mientras que los marcos de gobierno aún se definen de arriba hacia abajo. Incluso si cuentan con herramientas aprobadas por las empresas, a menudo las evitan en favor de otras herramientas más nuevas que están mejor posicionadas para mejorar su productividad.

A menos que los líderes de seguridad comprendan esta realidad, descubran y controlen esta actividad, están exponiendo a la empresa a riesgos importantes.

Por qué falla el bloqueo

Muchas organizaciones han intentado hacer frente a este desafío con una estrategia de «bloquear y esperar». Este enfoque busca restringir el acceso a plataformas de IA conocidas y esperar que la adopción se ralentice.

La realidad es diferente.

La IA ya no es una categoría que se pueda delimitar fácilmente. Desde aplicaciones de productividad como Canva y Grammarly hasta herramientas de colaboración con asistentes integrados, la IA está integrada en casi todas las aplicaciones de SaaS. El bloqueo de una herramienta solo lleva a los empleados a usar otra, a menudo a través de cuentas personales o dispositivos domésticos, lo que hace que la empresa no pueda ver su uso real.

Por supuesto, este no es el caso de todas las empresas. Los equipos de seguridad y gobernanza de la IA con visión de futuro buscan comprender de forma proactiva qué utilizan los empleados y para qué casos de uso. Buscan entender lo que está sucediendo y cómo ayudar a sus empleados a utilizar las herramientas de la forma más segura posible.

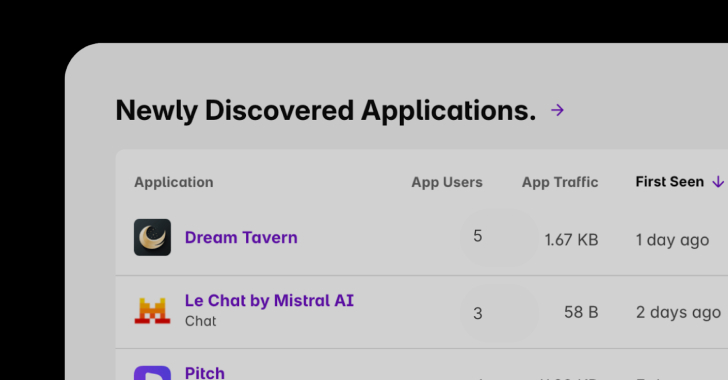

El descubrimiento de la IA en la sombra como un imperativo de gobernanza

Un inventario de activos de IA es un requisito reglamentario y no es algo que sea bueno tener. Marcos como la Ley de IA de la UE obligan explícitamente a las organizaciones a mantener la visibilidad de los sistemas de IA en uso, ya que sin descubrimiento no hay inventario, y sin inventario no puede haber gobernanza. La IA oculta es un componente clave en este sentido.

Las diferentes herramientas de IA plantean diferentes riesgos. Algunas pueden aprender discretamente con datos privados, mientras que otras pueden almacenar información confidencial en jurisdicciones como China, lo que pone en riesgo la propiedad intelectual. Para cumplir con la normativa y proteger la empresa, los responsables de seguridad primero deben descubrir todo el alcance del uso de la IA, que abarca tanto las cuentas empresariales autorizadas como las personales no autorizadas.

Una vez que dispongan de esta visibilidad, las organizaciones pueden separar los casos de uso de bajo riesgo de los relacionados con datos confidenciales, flujos de trabajo regulados o exposición geográfica. Solo así podrán aplicar políticas de gobierno significativas que protejan los datos y fomenten la productividad de los empleados.

Cómo ayuda Harmonic Security

Harmonic Security permite este enfoque al ofrecer controles de inteligencia para el uso de la IA por parte de los empleados. Esto incluye la supervisión continua de la IA oculta, con evaluaciones de riesgos listas para usar para cada aplicación.

En lugar de confiar en listas de bloqueo estáticas, Harmonic proporciona visibilidad del uso autorizado y no autorizado de la IA y, a continuación, aplica políticas inteligentes basadas en la sensibilidad de los datos, el rol del empleado y la naturaleza de la herramienta.

Esto significa que a un equipo de marketing se le puede permitir incluir información específica en herramientas específicas para la creación de contenido, mientras que los equipos legales o de recursos humanos no pueden usar cuentas personales para la información confidencial de los empleados. Esto se basa en modelos que pueden identificar y clasificar la información a medida que los empleados comparten los datos. Esto permite a los equipos aplicar las políticas de IA con la precisión necesaria.

El camino a seguir

La IA en las sombras ha llegado para quedarse. A medida que más aplicaciones SaaS incorporen la IA, el uso no administrado no hará más que expandirse. Las organizaciones que hoy no aborden el descubrimiento se encontrarán incapaces de gobernar mañana.

El camino a seguir es gobernarlo de manera inteligente, en lugar de bloquearlo. El descubrimiento de la IA en la sombra brinda a los CISO la visibilidad que necesitan para proteger los datos confidenciales, cumplir con los requisitos reglamentarios y capacitar a los empleados para que aprovechen de manera segura los beneficios de productividad de la IA.

Harmonic Security ya está ayudando a las empresas a dar el siguiente paso en la gobernanza de la IA.

Para los CISO, ya no se trata de si los empleados utilizan Shadow AI, sino de si pueden verla.

Post generado automaticamente, fuente oficial de la información: THEHACKERNEWS